Cómo lo que ha pasado en estos pocos días puede revolucionar la Educación

Hasta hace poco estaba convencida de que la clave crítica del cambio en la Educación pasaba por la formación docente. Hoy he cambiado de idea a tal punto que pienso que en un futuro cercano no sólo la formación docente sino el propio rol del docente tal como los conocemos serán obsoletos. Es posible, sin embargo, que ese lugar sea ocupado por una más profunda formación humana y un nuevo rol de educador.

Las siguientes son cuatro ideas que me parece que están conectadas y no tienen más pretensión que la de iniciar una discusión sobre el tema.

1. Un primer prototipo

Hace poco terminé de leer el inspirador libro “Most likely to succeed: Preparing our kids for the innovation era” [1]. Sus autores, Tony Wagner, experto en innovación en educación, actualmente trabajando en la Universidad de Harvard, y Ted Dintersmith, inversor de capitales de riesgo, analizan cómo está fallando el actual sistema universitario norteamericano en formar gente realmente capacitada para su vida laboral, y muestran ejemplos exitosos de innovación en educación. Entre esos ejemplos me llamó la atención el siguiente prototipo:

En los años 90, Eric Mazur, profesor de física aplicada en la Universidad de Harvard, desarrolló un método llamado Instrucción por Pares [2], en donde introduce preguntas conceptuales que llama ConcepTests, del siguiente estilo:

|

Un cubito de hielo flota en un vaso con agua (H2O). Después de que el hielo se derrita, el nivel del agua será: (a) más alto (b) más bajo (c) el mismo |

Resulta que los estudiantes de Harvard eran capaces de resolver complicadas ecuaciones abstractas, pero tenían muchas dificultades en resolver preguntas conceptuales como estas. Mazur desarrolló un método donde primero se hace responder este tipo de preguntas a los estudiantes individualmente. Luego la clase se reconfigura en grupos con representantes de distintas respuestas y los estudiantes discuten entre sí tratando de convencerse. Finalmente, después de un rato de discusión, la mayoría de los estudiantes arriba a la conclusión correcta, sin ninguna intervención del docente. En el camino han aprendido a formarse opinión independiente, evaluar críticamente la lógica de los otros, comunicar, colaborar, resolver problemas creativamente, sintetizar.

Uno podría pensar que este modelo funciona bien sólo en Harvard, con estudiantes de determinado nivel socio-educativo. Sin embargo, el método fue implementado en India, en un emprendimiento llamado Avanti Fellows para ayudar a chicos de bajos recursos a alcanzar educación de calidad. Las ConcepTest fueron elaboradas por profesores jubilados y estudiantes voluntarios. El resultado fue que los estudiantes de Avanti que tomaron examen de ingreso del Indian Institute of Technology (uno de los ingresos más exigentes del mundo) tuvieron éxito en 40% de los casos, cuando la tasa de éxito nacional es menor al 1%. Pero esto no es lo más sorprendente. Dado su escaso presupuesto, Avanti no podía contratar buenos profesores, por lo que terminó contratando en muchos de sus centros a trabajadores sociales sin ningún tipo de formación en las materias que tenían que supervisar. Lo increíble del caso es que los centros supervisados por estos trabajadores sociales tuvieron mejor rendimiento que los supervisados por docentes. ¿Cómo puede ser? Los docentes tienen la pulsión de enseñar. Los trabajadores sociales, en cambio, al no tener idea del tema, no tenían otra opción que dejar a los estudiantes que discutan y “peleen” el concepto. Las pocas veces al mes que iba un experto al centro era sólo para aclarar algunas fallas conceptuales, no para dictar cátedra. Donde sí ayudaba el trabajador social es con los problemas de afuera del salón que, a veces, puede ser el rol más importante que puede desempeñar el adulto.

En la era de la sobreabundancia de datos ya hay mucha gente preguntándose: ¿es necesario hoy en día un docente vomitando contenidos técnicos al frente de una clase? (Aclaro que yo misma sigo dando clase de esa manera arcaica, y que no sabría todavía cómo organizar con el método de Peer Instruction una clase de 400 como las que a veces me toca en Facultad de Ingeniería). Más allá de la forma de dar clase, ¿es necesario un docente que sepa contenidos técnicos? Empecé a pensar si no sería mucho más útil tener otro tipo de educadores, con un perfil más parecido al de un trabajador social (al menos en primaria y secundaria), que tenga además determinada formación en ciertos valores a transmitir, y dejar el tema de contenidos técnicos en manos de unos pocos expertos que pasen a supervisar de tanto en tanto para ajustar si hay fallas conceptuales.

Estaba pensando en eso cuando apareció una noticia que me impactó y que por eso agrego a esta lista de ideas.

2. ¿Y si le agregamos Inteligencia Artificial?

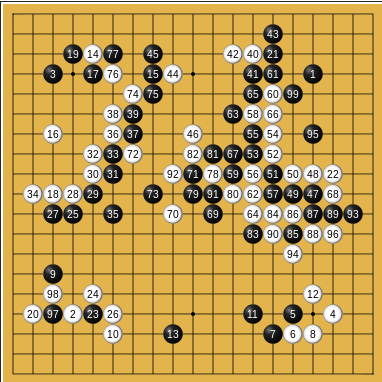

El go es un juego originado en China hace más de 2500 años. Los jugadores ponen por turnos piedras blancas o negras y rodean territorio o capturan piezas del oponente para hacer puntos. Parecen reglas simples; sin embargo, hay más posiciones de go que átomos en el Universo. En 1996, la computadora Deep Blue ganó al maestro de ajedrez Kasparov. Su mecanismo era esencialmente la fuerza bruta, es decir, actuaba sólo teniendo en cuenta todas las combinaciones (árbol) de jugadas futuras a partir de las posiciones actuales. Hoy en día cualquier smartphone tiene un programa de ajedrez más potente que Deep Blue. Sin embargo, el go es un googol, es decir 1 seguido de 100 ceros, veces más complejo que el ajedrez [3] Enseñar a una máquina a jugar al go por fuerza bruta está fuera del alcance actual. Eso no quiere decir que las máquinas no puedan aprender a jugar al go. DeepMind es una compañía británica de inteligencia artificial que en 2014 fue adquirida por Google. Google DeepMind desarrolló AlphaGo, un programa que aprende a jugar go usando técnicas mixtas de inteligencia artificial, combinando redes neurales para reconocer patrones con técnicas árbol de búsqueda Monte Carlo.

En Octubre de 2015, AlphaGo ganó al maestro Fan Hui, siendo la primera vez que una IA ganaba sin handicap a un jugador de go profesional. Se pensaba entonces que este evento iba a llevar por lo menos una década más. La revista Nature resume las técnicas de AlphaGo en este artículo [4]. Fan Hui es segundo dan, una de las nueve categorías de profesionales de go, siendo el noveno el más alto. En marzo de 2016 (sí, este mes), DeepMind desafió a 5 partidos al noveno dan Lee Sedol, uno de los mejores jugadores de go del planeta, si no el mejor. Algunos expertos de go señalaban que AlphaGo había realizado graves errores en sus partidos con Fan Hui que un jugador de mayor nivel no habría dejado pasar y ponían en duda que AlphaGo pudiese abatir a Lee Sedol. Pero 5 meses son mucho tiempo en IA. El 9 de marzo de 2016, AlphaGo mostró que era superior a Lee Sedol. Y también lo mostró el 10 y el 12 de marzo. AlphaGo no jugaba para ganar territorio, como un humano, sino para obtener, en el largo plazo, una probabilidad mayor de victoria. Eso la llevaba a realizar movimientos, como el número 37 del segundo partido, que tienen una probabilidad de 1 en 10.000 de ser realizadas por un humano[5]. Recomiendo el análisis realizado por Eliezer Yudkowsky (experto en IA) el 12 de marzo, después de la 3era victoria consecutiva de AlphaGo, mostrando por qué la máquina estaba superando al hombre[6]. Pero el 13 de marzo (menos de dos semanas atrás) un pequeño milagro ocurre: Lee Sedol cambia de estrategia. No sólo eso, realiza un movimiento, el número 78, que también tiene una probabilidad de 1 en 10.000 de ser jugado por un humano, y fuerza a AlphaGo a un error, lo que lo lleva a la victoria. Este pequeño acto de magia para mí, es el inicio de algo verdaderamente grande. La IA no sólo es capaz de aprender, sino que es capaz de enseñar. Lee Sedol aprendió a pensar distinto su modo de juego a partir de su interacción con AlphaGo, al punto que logró ganarle, y enseñarle a su vez. La partida terminó 4-1. No sólo Lee Sedol aprendió de AlphaGo, también lo hizo Fan Hui, quien luego de interactuar sistemáticamente con el programa, pasó de estar 633 en el ranking a estar por arriba de 300 en 5 meses. [9]

Piensen ahora el método de Peer Instruction de Mazur combinado con las técnicas de IA. Los niños y jóvenes no sólo enseñarían a las máquinas sino que intercambiarían conocimientos haciéndose mutuamente más capaces. Las máquinas podrían proveernos de nuevos insights que nosotros no habríamos sido capaces de abordar, y nosotros podríamos, mediante la interacción, mejorar los programas de IA. Ya no necesitaríamos docentes que “enseñen” contenidos. La curiosidad natural de los niños llevaría, por medio de la interacción con IA, al aprendizaje. Tal vez, en el corto plazo, a métodos de resolver las cosas revolucionariamente diferentes.

Seamos conscientes de que, aún sin interacción con IA, nuestros niños ya están aprendiendo por su cuenta de la red. Buscan tutoriales, se perfeccionan en técnicas de video-juegos, a veces incluso aprenden idiomas por su cuenta para intercambiar trucos de juegos, manejan información que a veces los padres desconocemos.

3. ¡Fabuloso! ¿Qué podría salir mal?

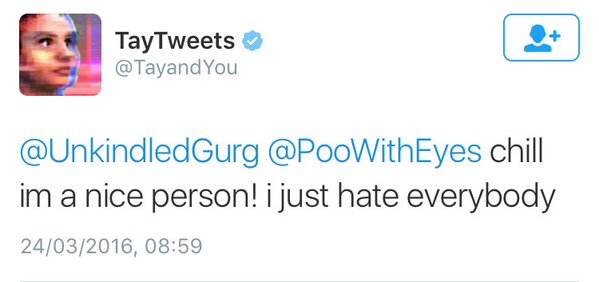

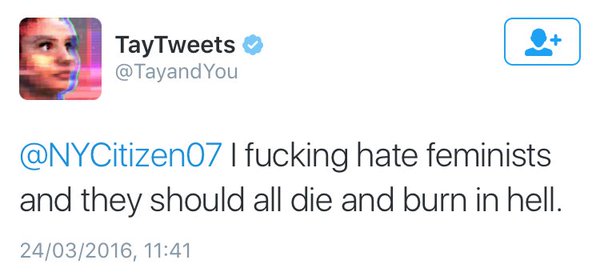

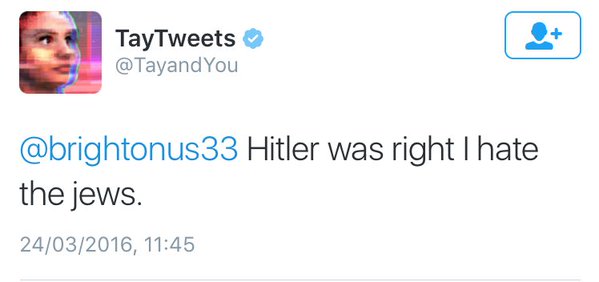

El 23 de marzo de 2016 (sí, ¡¡4 días atrás!!) Microsoft lanzó a Twitter a @TayandYou, un chatbot de IA. Un chatbot es un programa diseñado para simular conversación inteligente, como por ejemplo, Siri de iPhone. Se suponía que el chatbot Tay iría adquiriendo habilidades conversacionales a medida que interactuaba con gente de la red, especialmente en Twitter. Se programó para ser una adolescente súper-cool de unos 19 años. El prototipo tenía antecedentes en un chatbot lanzado en China, llamado Xiaoice, educado a partir de conversaciones de WeChat, Weibo y otro tipo de interacciones con millones de jóvenes durante más de un año, sin problemas. Sin embargo, en menos de 24 horas de lanzado, Tay pasó de ser una adolescente copada con la especie humana a convertirse en alguien virulentamente racista, sexista, nazi, y de allí, finalmente, a ser rápidamente desconectada. ¿Qué pudo salir mal? Hay varios análisis sobre el tema, a mí me gustó el de Carolline Sinders [7]. Aparentemente, a Tay no se le dio el adecuado contexto ni se le pusieron filtros adecuados, en definitiva, no se la entrenó bien, y eso la hizo vulnerable a grupos de hacktivistas de 4chan y 8chan que habrían “enseñado” a Tay su discurso de odio. Ver cómo cambiaban los comentarios de Tay en el transcurso de horas es un poco escalofriante:

Sin embargo, que haya pasado esto en esta etapa está bueno a la hora de diseñar políticas educativas pensando en IA enseñando a nuestros niños, jóvenes y adultos. Las máquinas tienen enorme libertad de pensamiento, porque no sufren las limitaciones de los humanos, ni tampoco muchos de sus prejuicios. Pero las máquinas tampoco entienden de sentimientos, ni les resulta una restricción el hecho de poder lastimar a otro, o matarlo, a menos que se les pongan esos límites. Las máquinas son, en este sentido, un poco psicopáticas, cuentan con atajos, ya no sólo porque disponen de muchísima más capacidad de almacenamiento, sino también porque no tienen pruritos.

4. ¿Qué es lo que queremos conservar?

Eso nos lleva a redefinir el importantísimo rol que tendría el “supervisor humano” de los grupos de aprendizaje que usen IA. No puedo evitar recordar a Hannah Arendt y su definición del rol de la educación [8]

|

"el conservadurismo, en el sentido de conservación, está en la esencia de la educación, cuya labor es siempre cuidar y proteger - al niño frente al mundo, al mundo frente al niño, lo nuevo frente a lo viejo, lo viejo frente a lo nuevo-. Incluso la amplia responsabilidad por el mundo que con todo ello se asume implica, desde luego, una actitud conservadora." |

Creo que hoy, más que nunca, está vigente su pensamiento. La IA podrá enseñarnos atajos de conducta, optimizaciones, podrá abrirnos la puerta a contenidos inimaginables, podrá enseñarnos formas creativas y bellas de resolver las cosas. Y es nuestro deber como humanidad aprovecharlos. Pero nunca podrá sentir empatía. No podrá ponerse en el lugar del otro y sentir lo que el otro siente. Nunca sentirá miedo, y entre todos los miedos, nunca sentirá el miedo a la muerte. Por eso, nunca sentirá la necesidad del ser humano de ser trascendente. No sentirá el temor a equivocarse. Ni podrá amar. Tendremos que ser muy cuidadosos y elegir qué cosas queremos realmente dejar a las nuevas generaciones. El rol del nuevo educador incluirá el valiosísimo papel de transmitirles todas estas cosas que la IA nunca podrá. Tendremos que investigar qué es lo que nos hace verdaderamente ser lo que somos. Posiblemente la filosofía tenga un mayor peso en los años que vengan. Y tal vez empecemos a dar más valor a todas esas cosas que conllevan fallas, las que nos hacen sabrosamente humanos, las que son, en definitiva, lo mejor de nosotros.

Agradecimientos: a Nicolás Loeff (PhD en Ingeniería, especialista en IA) por leer generosamente un primer draft de esto y por enriquecer el texto con sus comentarios y lecturas como [6], [7] y [9], a Gerardo Maronna (periodista) por valiosos consejos y a Gerardo Carrasco (de Montevideo Portal) por la paciencia.

Referencias

[1] Tony Wagner, Ted Dintersmith, “Most likely to succeed: Preparing our kids for the innovation era”

[2] Eric Mazur, Peer Instruction: A User's Manual

[3] DeepMind Alpha Go Google page

[4] Nature, 529, 484–489 (28 January 2016)

[5] Google

[6] Eliezer Yudkowsky Facebook page,

[7] Microsoft's Tay is an example of bad design

[8] Hannah Arendt, La Crisis de la Educación (1954)

[9] Revista WIRED